최근 몇 년 동안 휴대폰 세계는 큰 변화를 겪었습니다. 크기, 디자인, 성능 또는 기타 스마트 기능에 중점을 두는지 여부에 관계없이 거의 모든 측면에서 근본적인 차이점을 볼 수 있습니다. 현재 카메라의 품질은 상대적으로 중요한 역할을 합니다. 현재로서는 이것이 플래그십들이 끊임없이 경쟁하는 스마트폰의 가장 중요한 측면 중 하나라고 말할 수 있습니다. 또한 예를 들어 Android 휴대폰과 Apple iPhone을 비교해 보면 여러 가지 흥미로운 차이점을 발견할 수 있습니다.

그것은 수 관심을 가져라

모바일 기술의 세계에 관심이 있다면 센서 해상도의 경우 가장 큰 차이점 중 하나를 찾을 수 있다는 것을 확실히 알고 계실 것입니다. Android는 종종 50Mpx 이상의 렌즈를 제공하지만 iPhone은 수년간 12Mpx에만 투자해 왔으며 여전히 더 나은 품질의 사진을 제공할 수 있습니다. 그러나 이미지 포커싱 시스템에는 그다지 관심을 기울이지 않았는데, 여기서 다소 흥미로운 차이점이 발견되었습니다. Android 운영 체제를 탑재한 경쟁 휴대폰에는 종종 (부분적으로) 소위 레이저 자동 초점 기능이 사용되는 반면, 물린 사과 로고가 있는 스마트폰에는 이 기술이 없습니다. 실제로 어떻게 작동하고, 왜 사용되며, Apple은 어떤 기술을 사용합니까?

레이저 초점 대 iPhone

언급된 레이저 포커싱 기술은 매우 간단하게 작동하며 그 사용은 많은 의미가 있습니다. 이 경우 포토 모듈에 다이오드가 숨겨져 있어 트리거를 누르면 방사선이 방출됩니다. 이 경우 빔이 발사되어 촬영된 피사체/물체에 반사되어 돌아오며, 이 시간을 이용하여 소프트웨어 알고리즘을 통해 거리를 빠르게 계산할 수 있습니다. 불행하게도 어두운 면도 있습니다. 더 먼 거리에서 사진을 촬영할 때 레이저 초점은 더 이상 정확하지 않거나 빔을 안정적으로 반사할 수 없는 투명한 물체나 불리한 장애물의 사진을 촬영할 때 발생합니다. 이러한 이유로 대부분의 휴대폰은 여전히 장면 대비를 감지하기 위해 오랫동안 입증된 알고리즘에 의존합니다. 이러한 센서를 사용하면 완벽한 이미지를 찾을 수 있습니다. 이 조합은 매우 잘 작동하며 빠르고 정확한 이미지 포커싱을 보장합니다. 예를 들어, 인기 있는 Google Pixel 6에는 이 시스템(LDAF)이 있습니다.

반면에 약간 다르게 작동하는 iPhone이 있습니다. 그러나 핵심에서는 매우 유사합니다. 트리거를 누르면 최근 몇 년간 크게 개선된 ISP 또는 이미지 신호 프로세서 구성 요소가 핵심 역할을 합니다. 이 칩은 대비 방법과 정교한 알고리즘을 사용하여 최상의 초점을 즉시 평가하고 고품질 사진을 촬영할 수 있습니다. 물론, 얻은 데이터를 바탕으로 렌즈를 원하는 위치로 기계적으로 이동시켜야 하지만 휴대폰의 모든 카메라는 동일한 방식으로 작동합니다. "모터"에 의해 제어되지만 움직임은 회전하지 않고 선형입니다.

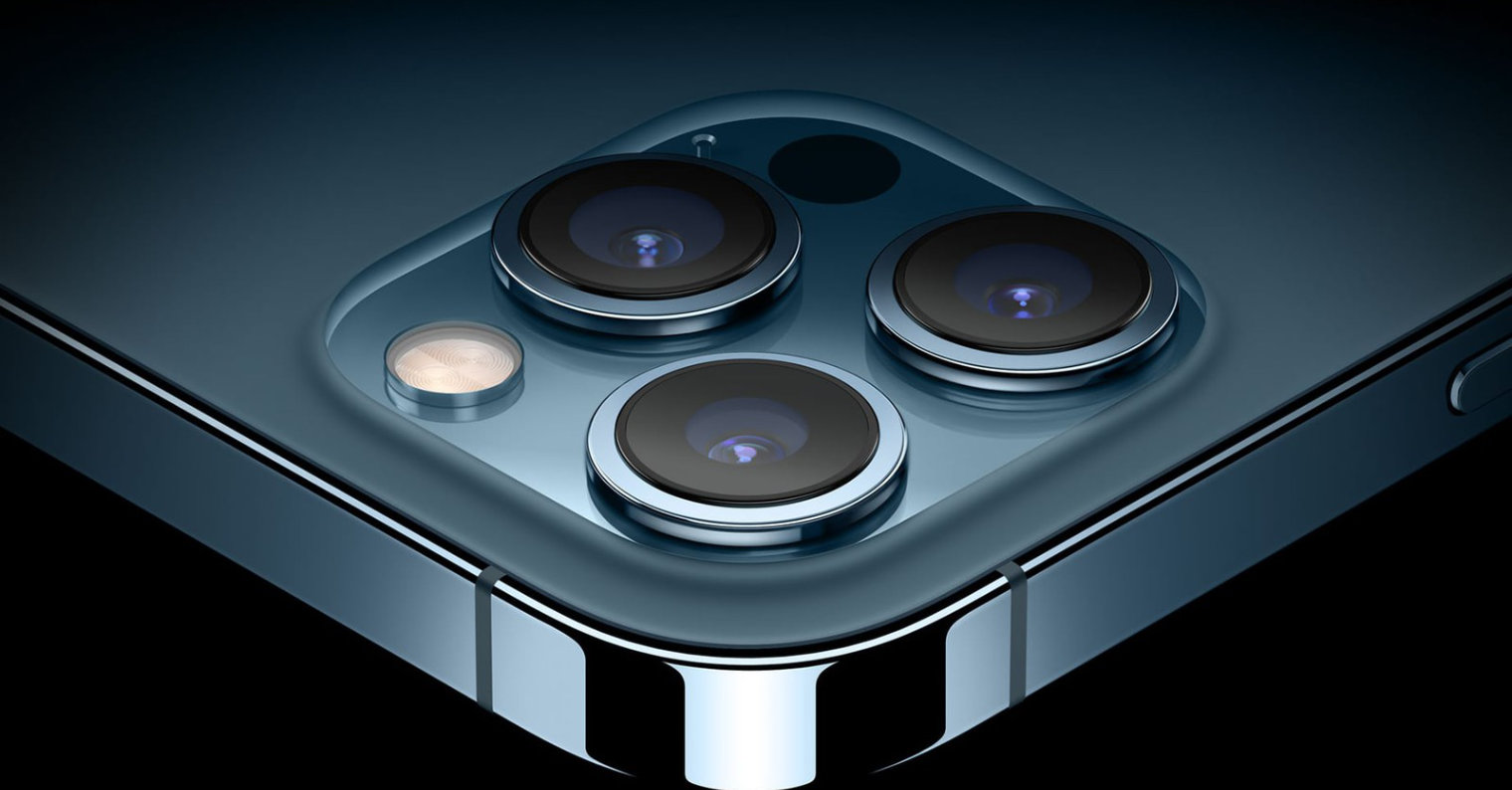

한 단계 앞서 있는 것은 iPhone 12 Pro(Max)와 iPhone 13 Pro(Max) 모델입니다. 짐작하셨겠지만, 이 모델에는 촬영된 피사체와의 거리를 즉시 확인하고 이 지식을 활용할 수 있는 소위 LiDAR 스캐너가 장착되어 있습니다. 실제로 이 기술은 언급된 레이저 초점에 가깝습니다. LiDAR는 레이저 빔을 사용하여 주변 환경의 3D 모델을 생성할 수 있으므로 주로 스캐닝 룸, 자율 주행 차량 및 사진 촬영(주로 인물 사진)에 사용됩니다.

그것은 수 관심을 가져라

아담 코스

아담 코스

Apple과 함께 세계일주

Apple과 함께 세계일주